助记词生成器生成tron地址 全球首个多模态宇宙模子Emu3来了!智源王仲远:为多模态大模子考试范式指明新所在

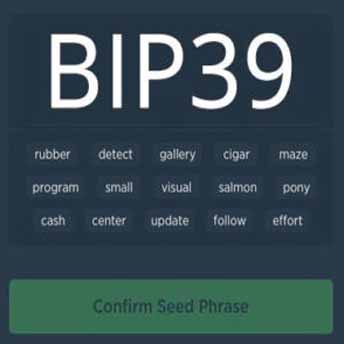

助记词生成器生成tron地址

助记词生成器生成tron地址

智源 Emu3 生成的 AI 视频案例

全球首个原生多模态宇宙模子来了。

钛媒体 App 获悉,10 月 21 日,北京 AI 领域新式非渔利计议机构北京智源东谈主工智能计议院(以下简称"智源计议院",BAAI)发布吸收了自归来(autoregressive)时间阶梯的原生多模态宇宙模子 Emu3,并同步上线时间文档、开源要害时间等供产业界进一步探索。

据悉,Emu3 参数目为 8B(80 亿),只基于下一个 token(输入数据的基本单元)估计,无需扩散模子或组合式方法,把图像、文本和视频编码为一个破碎空间,在多模态夹杂序列上重新开动王人集考试一个 Transformer 模子。该模子结束了视频、图像、文本三种模态的融合通晓与生成,传统模子则只可处理一种类型。而在图像生成、视觉说话通晓、视频生成任务中,Emu3 的阐扬特出了图像生成模子 Stable Diffusion SDXL 、视觉说话通晓模子 LLaVA、视频生成模子 OpenSora 等国表里主流开源模子,展示了海外最初的 AI 时间。

智源计议院院长王仲远向钛媒体 App 等示意,Emu3 施展了下一个 token 估计能在多模态任务中有高性能的阐扬,这为构建多模态 AGI 提供了开阔的时间出路。Emu3 有契机将基础设施缔造不休到一条时间阶梯上,为大范围的多模态考试和推理提供基础,这一简陋的架构遐想将利于产业化。改日,多模态宇宙模子将促进机器东谈主大脑、自动驾驶、多模态对话和推理等场景应用。

王仲远强调助记词生成器生成tron地址,行业一定会有一个融合的多模态模子。

"智源会坚抓作念原始革命。咱们合计原生大一统的多模态大模子,是统统大模子发展时间阶梯上必须要去攻克的一个时间所在。Emu3 是全球首个基于该时间阶梯的原生多模态宇宙模子,并面向海外社区进行了开源。"王仲远坦言,中国在大模子的时间阶梯上要有我方的中枢时间,而 Emu3 能为多模态大模子考试范式指明新的所在。

图像文本视频大一统,王仲远:原生多模态宇宙模子处在" GPT-3 时刻"

智源计议院成立于 2018 年 11 月,是全球最早开展 AI 大模子的中国非渔利性新式计议机构,亦然北京市继脑科学与类脑计议中心、量子信息科学计议院之后,效力缔造的又一个重要的新式研发机构。

智源计议院为了加速 AI 前沿时间落地,围绕大模子、类脑脉冲芯片、领路学问图谱、安全东谈主工智能、疾病脑电、智能信息处理等最初时间的熟谙化、工程化确立革命中心,推动 AI 原创后果振荡及产业化。

2024 年 2 月,智源计议院文书王仲远博士担任新任院长,全面风雅计议院各项职责。在此之前,王仲远在 AI 学术及产业领域深耕长达 15 年以上,曾在微软、Facebook(现 Meta)、好意思团、快手等多家头部公司任职过。

Emu3 所使用的自归来时间阶梯的中枢想想是诳骗序列数据中的高下文依赖性来估计改日的数据点。该类型模子中,不同模态数据分享归拢套参数,可结束跨模态的关联和生成,无需东谈主工遐想的特征工程。同期因自归来时间阶梯的特质,在生成数据时模子必须按行动进行助记词生成器生成tron地址,收尾了并行狡计的才略,导致生成速率较慢。也会碰到耐久依赖问题,即模子难以捕捉序列中较远距离的依赖关系。

所谓"宇宙模子"是面前时间家数中难度最高的一种,其特质在于让机器省略像东谈主类一样对信得过宇宙有一个全面而准确的领路,不仅包括对事物的形容和分类,还包括对事物的关系、章程、原因和收尾的通晓和估计,从而进行推理和决策,而"宇宙模子"也被合计是通往 AGI 的最优解。

同期,谷歌与麻省理工学院(MIT)何恺明团队王人集股东了一个新计议表情,推出名为 Fluid 的图像自归来模子,吸收勾通 token 生成样式和立时行动生成单张图片;图灵奖得主、Meta 首席 AI 科学家杨立昆(Yann LeCun)相似的 Meta AI 团队曾推出 V-JEPA 宇宙模子,一种通过不雅看视频来教机器通晓和模拟物理宇宙的方法;李飞飞提到的所谓"空间智能"亦然宇宙模子的一种时间所在;而在国内,智源计议院也率先推出自归来阶梯多模态宇宙模子 Emu3。

王仲远合计,Emu3 的发布意味着大模子省略通过更多维度的数据来通晓、学习信得过宇宙。

具体来看,左证智源计议院 9 月底发布的时间申诉,Emu3 模子参数目为 80 亿,包括了翰墨、图片和视频原始数据,并将视觉数据 Token 化从而在融合的架构下进行考试,不错生成翰墨、各样化立场的图片和最长为 5 秒的视频,况兼能抓续估计下一个 Token 词元。

评测收尾显露,英文提醒词下,该模子图片生成得分为 70.0 分,最初于 Stability AI 于 2023 年 7 月推出的 SDXL 的 66.9,过时于 OpenAI 于 2023 年 8 月推出的 DALL E3 的 73.4 分;文生视频得分则为 81.0 分,最初于本年 6 月开源的 OpenSora 1.2 的 79.6 分;说话才略,时间申诉未提供商酌测评数据,主要由于 Emu3 说话类数据占比小,参数远小于市面上其他的说话大模子助记词生成器生成tron地址,因此面前说话才略并不在第一梯队,但 Emu3 模子词汇量达 184622,高下文长度达到 131072,具有好多说话模子的时间才略。

王仲远合计,面前吸收自归来架构构建融合的多模态宇宙模子仍处在应用爆发前的" GPT-3 时刻",如今的多模态领域还处于绝顶早期,因此 Emu3 只是在前沿时间层面施展了该阶梯的可能性,改日仍需和产业界协作进一步扩大考试范围,并将 Emu3 推向公共省略波及的应用。

算力、数据、生态仍是现时多模态宇宙模子的挑战

事实上,近期对于" OpenAI 研发的 AI 模子时间是否是改日通用东谈主工智能(AGI)的所在"争议颇多。其中,苹果公司里面职工承认"生成式 AI 时间过时竞品两年以上",外部告成质疑 OpenAI o1 的 AI 推理才略较差,无法贬责部分小学数学题内容;而杨立昆则直言,今天的 AI 大模子比猫还笨,以致合计 Sora 并不可果然通晓物理宇宙,这么的视频生成与宇宙模子的因果估计仍然存在雄壮各异。

对此,王仲远向钛媒体 App 坦言,他部分认同杨立昆的说法,照实需要多模态宇宙模子通往 AGI 主义,但不一定要模仿生物大脑遐想多个不错类比的自主性 AI 系统子功能模块这种决策。

"杨立昆提的对于当今大模子比猫还笨,很重要的一个论点是他合计纯说话模子无法抵达 AGI。咱们也合计纯说话模子是不够的,因为仅从文本层面无法王人备通晓宇宙。事实上,一些科学家,包括谢赛宁博士,在尝试通过视觉信号直战斗发智能才略的时间阶梯。说话是重要的,但唯一说话是不够的。要是要通晓感知、推理这个宇宙,起始要看获得、嗅觉到宇宙,能力把不同模态的信息进行交互通晓。这恰正是 Emu3 融合多模态时间阶梯的重要孝顺。但另一方面,对于杨立昆冷落来仿照东谈主脑遐想自主 AI 系统模块,我合计应该长期饱读吹和补助不同的时间阶梯的探索,融合多模态宇宙模子等于其一。"王仲远示意。

Keras 之父 Francois Chollet 也合计,大模子通过提醒使用时助记词生成器生成tron地址,无法通晓与考试数据中情况大相径庭的情况,因此不具备通用智能,而大模子的主要作用是算作本体 AGI 的学问和要领存储,它们是一种操心样式,而智能不单是是操心。

不外,现时 Emu3 这种原生多模态宇宙模子依然存在诸多"局限性",比如统统考试数据范围不够大,低于 Emu2 的 370 亿参数和东谈主类的 860 万亿 -1000 万亿神经元范围,使得说话效果无法达到 GPT-o1 水平;算力范围不够大,面前智源的 AI 异构算力平台与行业最大范围的算力集群范围依然有一定距离;另外,现时宇宙模子阶梯莫得生态和膨胀者,亟待更多企业和大公司进行营业落地,从而考据这条阶梯的正确性。

"咱们需要更多资源,举例,Emu3 参数扩大 10 倍所需的算力、工程化的才略是指数级加多的,是以需要协作伙伴和咱们全部考试下一代的模子。"王仲远对钛媒体 App 示意。

谈及预考试大模子不再考试时,王仲远强调,在时间阶梯不休的趋势下,厂商会更积极地探索模子的落地场景。从乐不雅的角度来看,证据基础大模子还是达到一定的才略水平。另从严慎的角度来说,考试转推理证据仅靠市集驱动,会令厂商堕入"奴隶者"的境地,不利于原始时间革命。

"咱们一直强调智源的定位,是作念原始革命,作念企业不肯意作念,高校作念不了的事情,是以这使得咱们必须作念下一代 AI 时间探索,作念改日 3 年 -5 年可能被行业招供的时间阶梯。在多模态方朝上,智源需要为统统行业指明一个所在。"王仲远称。

以下是智源计议院团队与钛媒体 App 等部分对话交流整理:

问:比拟 Emu 2,Emu3 模子参数目减少助记词生成器生成tron地址,幻觉会不会更严重?

智源计议院:起始简陋先容 Emu3 和 Emu 2 的时间隔离。Emu2 视觉用的照旧 embedding 的样式,Emu3 酿成了破碎的 token。Emu1,Emu 2 是意见考据加探索迭代。那时用了预训好的说话模子和扩散的 decoder,快速考据融合的生成式是否能走通,智源是海外上最早作念的探索。因为不需要考试说话模子,基于已有的,资本会比较低。Emu3 咱们是王人备重新考试,是为视频图像文本原生多模态遐想的。

问:Emu3 视频好像最多 5 秒 24 的 FPS,这与其他估计模子的隔离?

智源计议院:下一个 token 自然的公正是自己就不错续写,看到前边的 token 估计后头的 token,不错无穷续下去。只是要是在一个场景续写,看到的长视频都是一个场景,酷好不大。当今举座的续写才略还莫得冲破长的多情节的视频生成。Emu3 这套框架的独到上风等于因果性,不错基于前边发生的事情估计后头发生的事情,而不是基于一堆噪声去假想。Emu3 当今不错 5 秒一直续写。

问:有莫得盘算在科学狡计上的应用?

智源计议院:AI for Science 多模态辱骂常必须的。GPT 3 到 ChatGPT 花了两年半的时辰,Emu3 好比畴前的 GPT3,Emu3 是一个中间的 milestone(里程碑),下一个期待肖似 ChatGPT 的的 milestone。

问:智源改日三到五年之内的要点是什么?

智源计议院:赓续研发原生多模态宇宙模子 Emu 系列,贬责更大范围的数据、算力以及考试 。融合多模态基座大模子是东谈主工智能干与到物理宇宙绝顶重要的基座。多模态具身大脑亦然计议院正在作念的计议。本年咱们也看到了诺贝尔的物理学奖给了 Hinton 解释,化学奖是给了 DeepMind 团队。AI for Science 亦然智源绝顶温煦的重要计议所在。

问:从 To C 端角度来说,APP 详情是最佳的样式,智源改日有莫得盘算和一些其他协作伙伴推出一些 c 端 APP?

智源计议院:现时市集上的说话模子 APP 还是开动基于百亿模子在使用,这个前提是有了千亿、万亿模子,达到更高的性能,百亿模子效果随之更好。而当今,多模态大模子还在连接探索才略上限。智源探索出了 Emu3 这么一条时间阶梯,那么接下来需要展示,也期待在多模态领域的" ChatGPT " 的时刻。

我想再一次强调 Emu3 架构的优厚性,将来多模态大模子都省略绝顶容易使用,这是 Emu3 模子的酷好。

(本文首发于钛媒体 App,作家|林志佳,剪辑|胡润峰)

https://chumagames.com/zhujicizhuanhuansiyue/2411.html